更多“数据分析的方法不包括()。”相关的问题

更多“数据分析的方法不包括()。”相关的问题

第1题

LDA(线性区别分析)与PCA(主成分分析)均是降维的方法,下面描述不正确的是()。

A.PCA和LDA均是基于监督学习的降维方法

B.假设原始数据一共有K个类别,那么LDA所得数据的降维维度小于或等于K−1

C.LDA降维后所得到维度是与数据样本的类别个数K有关(与数据本身维度无关)

D.PCA对高维数据降维后的维数是与原始数据特征维度相关(与数据类别标签无关)

第4题

利用BARIUM.RAW中的数据。 (i)用前119次观测(即不包含1988年的最后12个月观测),估计线性趋势模

利用BARIUM.RAW中的数据。

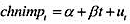

(i)用前119次观测(即不包含1988年的最后12个月观测),估计线性趋势模型 。这个回归的标准误是什么?

。这个回归的标准误是什么?

(ii)同样用除了最后12个月以外的所有数据,估计chnimp的一个AR(1)模型。把这个回归的标准误与第(i)部分中的标准误相比较。哪一个模型提供了更好的样本内拟合?

(iii)用第(i)和第(ii)部分中的模型计算1988年12个月的提前一期预测误差。(每个方法都应该得到12个预测误差。)计算并比较这两种方法的RMSE和MAE。就样本外提前一期预测而言,哪种方法效果更好?

(iv)在第(i)部分的回归中添加月度虚拟变量。它们是联合显著的吗?(当我们检验联合显著性时,不必担心误差中轻度的序列相关。)

第8题

逻辑斯蒂回归和线性区别分析均可完成分类任务,下面描述正确的是()。

A.逻辑斯蒂回归和线性区别分析都是直接在数据原始空间进行分类

B.以上都不正确

C.逻辑斯蒂回归可直接在数据原始空间进行分类,线性区别分析需要在降维所得空间中进行分类

D.逻辑斯蒂回归在降维所得空间中进行分类,线性区别分析在数据原始空间进行分类

如果结果不匹配,请

如果结果不匹配,请